Gjør det vanskeligere å mobbe i sosiale medier

Forskere har utviklet en metode som gjør det enklere å stoppe sjikane og hatske meldinger på nettet.

Bruken av sosiale medier, nettforum og blogger er eksplosiv. Over fire millioner nordmenn har en profil på sosiale medier. Stadig flere blir utsatt for hatefulle ytringer på nett, som rasistiske eller sexistiske kommentarer, eller annen mobbing.

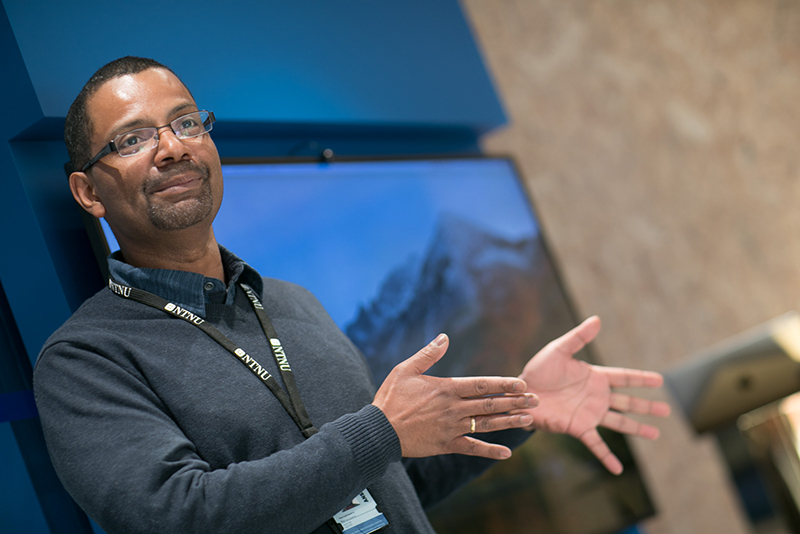

– Hovedmotivasjonen vår er å gjøre det enklere å renske bort sjikane og mobbing fra nettet. Jeg tenker særlig på sårbare ungdommer. Det er alt for mange av dem som opplever nettmobbing og trakassering, sier Heri Ramampiaro. Han er førsteamanuensis ved Institutt for datateknologi og informatikk ved NTNU.

Kan brukes på alle språk

Det finnes i dag flere løsninger som rensker bort uønskede ytringer i tekst.

Metoden Ramampiaro og kollegaene på Norwegian Open AI Lab har utviklet, skiller seg fra eksisterende løsninger ved at den i tillegg til tekstanalyse, analyserer mønstre på brukere. Det betyr at den ser på tendensen enkelte har vist i tidligere meldinger, med å uttrykke seg støtende.

Den nye metoden kan brukes til å filtrere bort hatefulle meldinger, før de publiseres, sier Heri Ramampiaro. Foto: Kai Dragland, NTNU

Metoden som er basert på maskinlæring, trenes opp til å kjenne igjen tendensene til å uttrykke seg støtende og rensker ut både enkeltord og setninger. Den kan brukes til å filtrere bort hatefulle meldinger, før de publiseres.

– Den kan trenes opp til å håndtere et hvilket som helst språk. Den er språkuavhengig, poengterer han.

Testet på tweets

Forskerne har testet dette opp mot 16 000 Twitter-meldinger og ser at løsningen med hell skiller ut rasistiske og sexistiske utsagn fra vanlig tekst.

– Metoden har bedre evne til å identifisere støtende ytringer og skille disse fra normale/nøytrale ytringer enn eksisterende state-of-the-art metoder. Den er dermed mer effektiv enn andre løsninger som finnes i dag, mener Ramampiaro.

Forskerne har hatt fokus på at det skal være mulig å integrere metoden i et system som kan klassifisere strøm av tekst, som twitter-meldinger og liknende.

Kan spare arbeidskraft

Ramampiaro ser for seg at metoden kan brukes med god virkning, både i sosiale medier og i nettdebatter i avisene.

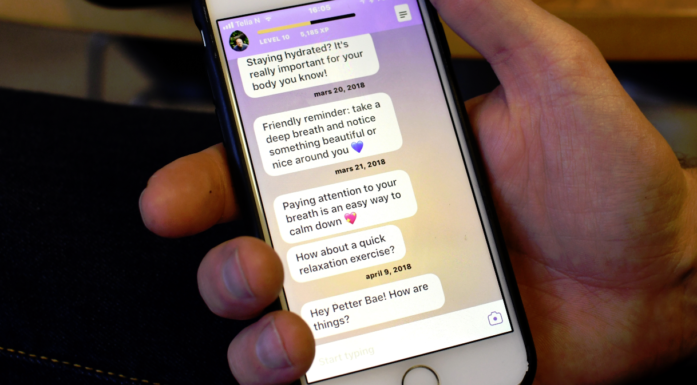

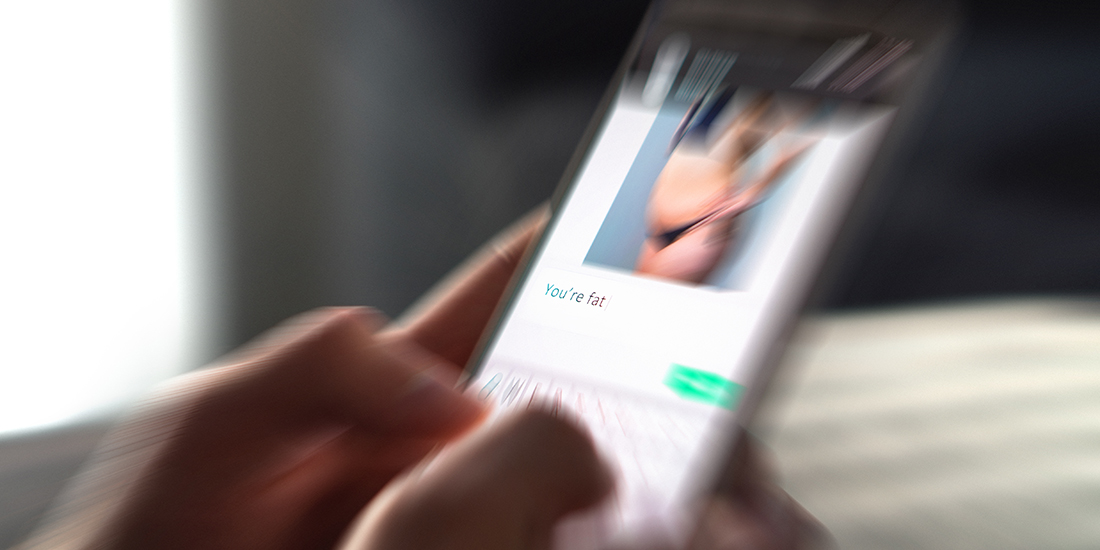

Det er alt for mange av de unge som opplever nettmobbing og trakassering, sier Heri Ramampiaro. Illfoto: NTB scanpix

I dag er det vanlig i norske mediehus at personer har ansvar for å luke bort hatefulle ytringer etter at disse har blitt publisert i kommentarfeltene deres. Hva som lukes bort er subjektivt – og ikke minst, det er svært tidkrevende.

– For mediehus som opplever å få debatter ødelagt av hatefulle kommentarer, kan konsekvensen bli at debattsidene må stenges.

– Om debatter forstummer, på grunn av hets, så kan det bli et demokratisk problem, sier Ramampiaro.

Etiske dilemmaer

Det er effektivt å bruke en slik teknologisk metode til å følge med på brukere som har en større tendens enn andre til å spre rasistiske og sexistiske utsagn, men utløser samtidig noen etiske dilemmaer.

– Kan en programvare ta de rette vurderingene i forhold til ytringsfrihet og sensur?

– Hva som filtreres bort bør et menneske ha ansvar for. Selv om maskinen kan gjøre det, så er ikke det hensiktsmessig. Men når systemansvarlig har lagt inn og klassifisert noe som støtende, så renser metoden dette bort, sier Ramampiaro.

Tweeter på dialekt

En annen utfordring er at hatefulle meldinger eller tweets ofte skrives med forkortelser, slang eller på dialekt.

– Engelske tweets kan være vanskelige, rent språklig, fordi forkortelser og slang brukes. Men norsk er faktisk enda mer kompleks, da vi har så mange dialekter. Og det er ganske typisk å skrive tweets på dialekt, forklarer Ramampiaro.

Sosiale medier i Norge

I følge Ipos har i underkant av 3,5 millioner nordmenn over 18 år en profil på Facebook, og 83 % av disse er innom FB daglig.

Over 1,8 millioner nordmenn som har en profil på YouTube.

2,6 millioner nordmenn har en Snapchat-profil.

2,2 millioner nordmenn bruker Instagram.

I underkant av 1,2 millioner nordmenn har en profil på Twitter

Statistisk sentralbyrå oppgir at 80 prosent av nordmenn mellom 16 og 79 år bruker sosiale medier. Blant de som er mellom 16 og 24 år er ni av ti på sosiale medier daglig eller nesten daglig.

Nå går forskerne videre med å samle inn et enda større datagrunnlag og teste metoden på flere språk.

De ønsker også å utvide metoden til å omfatte tale, noe som vil gjøre anvendelsesområdet større. Men dette ligger noe fram i tid.

– Vi driver med basisforskning som har et anvendelsesaspekt, sier han.

– Det er straffeloven som skal sørge for sanksjoner

Toril Aalberg, leder ved NTNUs Institutt for sosiologi og statsvitenskap, har blant annet jobbet med politisk kommunikasjon. Hun mener at intensjonen med metoden til Open AI-Lab er god, men poengterer at det er flere etiske problemstillinger knyttet til dette.

– Ytringsfriheten er innført for å verne nettopp om ytringer vi ikke liker, mens straffeloven skal sørge for sanksjoner mot de som offentlig fremsetter diskriminerende eller hatefulle ytringer. Det kan fort bli problematisk om det bare er brukere som har kommunikasjonsmønstre med forhåndsgodkjente “normale og nøytrale ytringer” som når offentligheten, sier Aalberg.

Hun henviser til at det ikke er lenge siden vi hadde en debatt om Facebook sin pre-sensur av det ubehagelige, men historisk viktige bildet av den nakne “napalm-piken” i Vietnam.

– Intensjonen var god, men resultatet ble helt feil. En annen vel så viktig problemstilling er knyttet til at slike teknologiske sensurløsninger ikke vil fjerne hatet i seg selv, som vel så gjerne kan komme til uttrykk i andre kanaler, sier Aalberg.

Kan redde liv

Heri Ramampiaro sier forskerne er bevisste på at det er flere etiske dilemmaer. Han synes det er utfordrende å se inn i glasskula og beskrive hvilke konsekvenser metoden vil få, men en ting vet han sikkert:

– Jeg håper metoden kan gjøre at vi får en mer effektiv utluking av ytringer som sjikanerer andre. Å bli utsatt for hatske meldinger, rasisme og sexisme kan være svært belastende for den enkelte og kan i verste fall få fatale følger. Det finnes eksempler på at sårbare ungdommer har endt opp med å ta sitt eget liv på grunn av nettmobbing, sier Ramampiaro og tilføyer:

– Om så vi bare redder et eneste liv, så er det verdt det.

Referanse: ”Effective hate-speech detection in Twitter data using recurrent neural networks” av Georgios K. Pitsilis, Heri Ramampiaro og Helge Langseth